Quais são os desafios éticos da Inteligência Artificial?

O uso da Inteligência Artificial (IA) tem transformado o cotidiano das pessoas de forma inesperada, que vão desde sistemas que personalizam as experiências on-line à robôs que já estão sendo testados em cirurgias médicas. Com isso, é preciso se atentar ao poder do uso da IA e nas responsabilidades éticas que podem ir desde discriminação algorítima, falta de transparencia e invação de privacidades para capatação de dados com objetivo de alimentar o banco de dados da IA.

Neste artigo, vamos abordar sobre o que é ética na IA e por que é um assunto tão fundamental para compor princípios éticos e morais na utilização da IA. Além disso, iremos ver como o Brasil está lidando com os desafios éticos no uso de sistemas.

Panorama sobre os desafios éticos na IA

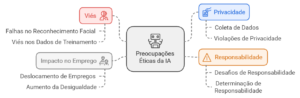

As pesquisas indicam que, à medida que a IA se torna mais presente, surgem preocupações sobre como garantir seu uso responsável e ético. Um estudo do Fórum Econômico Mundial destaca que os principais dilemas éticos incluem viés algorítmico, privacidade, responsabilidade e transparência.

Confira alguns dados relevantes:

- Viés Algorítmico: Sistemas de IA podem intensificar preconceitos já existentes se forem treinados com dados tendenciosos. Um exemplo disso é o reconhecimento facial, que pode falhar ao identificar corretamente pessoas de grupos étnicos que são sub-representados.

- Privacidade: A coleta de grandes quantidades de dados pessoais para o treinamento de algoritmos levanta preocupações sobre possíveis violações de privacidade. Uma pesquisa da Alura destaca a importância de proteger os direitos dos indivíduos e garantir a segurança das informações utilizadas.

- Responsabilidade: A dificuldade em determinar quem é responsável por decisões tomadas por sistemas autônomos representa um dilema significativo. Em situações de falhas ou danos causados pela IA, identificar o responsável (seja o desenvolvedor, o usuário ou a própria IA) continua a ser um desafio.

- Impacto no Emprego: A automação promovida pela IA pode levar à substituição de postos de trabalho humanos, resultando em um aumento do desemprego e da desigualdade social. Estima-se que até 2025, 85 milhões de empregos poderão ser afetados pela automação.

Essas informações evidenciam a necessidade urgente de estabelecer diretrizes éticas sólidas para a criação e implementação da IA. A adoção de princípios que priorizem a justiça, a transparência e a responsabilidade é fundamental para maximizar os benefícios da IA, ao mesmo tempo em que se mitigam os riscos para a sociedade.

O que é ética na Inteligência Artificial?

Quando falamos de ética na IA estamos nos referindo ao conjunto de princípios e práticas que garantem o desenvolvimento e o uso de sistemas de IA de forma justa e responsável.

Diferentemente de outras tecnologias, a IA possui um impacto mais profundo e, muitas vezes, invisível nas decisões que afetam a vida das pessoas, o que torna as questões éticas ainda mais desafiadoras.

A essência da ética na IA está em garantir que os sistemas operem com base em valores humanos fundamentais, como justiça, privacidade, autonomia e segurança. Isso significa, por exemplo, evitar que um algoritmo discrimine com base em raça ou gênero e assegurar que decisões automatizadas possam ser explicadas de maneira compreensível para os usuários.

Além disso, a ética na IA envolve um equilíbrio delicado entre inovação tecnológica e proteção de direitos individuais. À medida que as máquinas se tornam mais capazes, surge uma responsabilidade proporcional para que desenvolvedores e organizações assumam um papel ativo na mitigação de riscos e impactos negativos.

Influências morais na utilização da Inteligência Artificial

As influências morais no uso da IA são moldadas por fatores culturais, econômicos e sociais que variam amplamente ao redor do mundo. Esses fatores determinam como a IA é percebida, desenvolvida e aplicada, e também afetam os debates éticos em torno dela.

Cultura coletivista vs. individualista

Em sociedades coletivistas, como a China, a IA é frequentemente utilizada para vigilância em massa com o argumento de que isso promove a segurança pública e a ordem social. Por exemplo, o sistema de câmeras de vigilância equipadas com reconhecimento facial em cidades chinesas é justificado como uma medida para prevenir crimes e garantir a segurança coletiva.

Em contrapartida, em culturas que valorizam a autonomia individual, como nos Estados Unidos e na Europa, esse mesmo uso é frequentemente visto como uma violação grave dos direitos civis e da privacidade. A resistência ao uso de tecnologias invasivas reflete uma preocupação com a liberdade pessoal e os direitos humanos.

Interesses econômicos e ética

Os interesses econômicos também desempenham um papel crucial nas decisões sobre a implementação da IA. Muitas empresas priorizam lucros e eficiência em detrimento de considerações éticas. Um exemplo disso é o uso de algoritmos de recrutamento que, se não forem projetados com cuidado, podem perpetuar discriminações raciais ou de gênero.

A empresa Amazon enfrentou críticas por um sistema de recrutamento que favorecia candidatos masculinos, refletindo vieses presentes nos dados históricos utilizados para treinar o algoritmo. Isso evidencia como decisões motivadas por eficiência podem resultar em consequências sociais negativas.

Dilemas práticos e responsabilidade

Dilemas morais práticos surgem quando se considera a automação em setores críticos. Por exemplo, a introdução de robôs em linhas de montagem pode aumentar a eficiência, mas também comprometer empregos humanos. A Ford anunciou planos para automatizar partes significativas de sua produção, levantando preocupações sobre o futuro dos trabalhadores da indústria automotiva. Além disso, questões sobre responsabilidade se tornam complexas quando sistemas autônomos cometem erros. Em casos de acidentes envolvendo veículos autônomos, como os incidentes com carros da Tesla, surge a pergunta: quem é responsável? A resposta não é simples pois acaba envolvendo desenvolvedores, fabricantes e usuários.

Exemplos de violação de privacidade causada pela Inteligência Artificial

Debater e falar sobre o uso da ética é primordial para a utilização da IA que tem gerado preocupações significativas em relação à privacidade dos dados, resultando em várias violações notórias. Confira abaixo alguns casos que ilustram como a IA pode comprometer informações pessoais e sensíveis, levantando questões éticas e legais sobre o uso responsável dessa tecnologia.

Escândalo do Facebook e Cambridge Analytica

Um dos casos mais emblemáticos de violação de privacidade envolvendo IA foi o escândalo do Facebook e Cambridge Analytica. A Cambridge Analytica coletou dados de milhões de usuários do Facebook sem o consentimento deles, utilizando esses dados para criar perfis detalhados e direcionar anúncios políticos personalizados durante campanhas eleitorais. Esse incidente não apenas expôs a vulnerabilidade dos dados pessoais, mas também destacou como técnicas de IA podem ser usadas para manipular comportamentos e opiniões públicas.

Vazamentos de dados e ataques cibernéticos

A IA também é utilizada em ataques cibernéticos que visam roubar dados pessoais. Um exemplo significativo ocorreu com a Equifax, uma empresa de gestão de crédito que sofreu uma violação em 2017, expondo informações pessoais de aproximadamente 147 milhões de pessoas. Embora a violação em si não tenha sido causada diretamente pela IA, técnicas de análise de dados baseadas em IA foram usadas posteriormente para explorar os dados roubados

Deepfakes e desinformação

A crescente popularidade da IA generativa destacou o surgimento dos deepfakes, que consistem em vídeos ou áudios alterados para simular a realidade. Esses materiais podem ser utilizados para prejudicar a imagem de pessoas ou disseminar informações falsas, colocando em risco a privacidade e a reputação dos indivíduos. Uma pesquisa realizada pela Universidade de Stanford revelou que modelos de IA têm a capacidade de extrair dados pessoais sensíveis de textos acessíveis publicamente, elevando a probabilidade de fraudes e ataques cibernéticos.

Com o crescimento da IA generativa, há um risco crescente relacionado ao compartilhamento excessivo de dados pessoais. Muitas aplicações requerem que os usuários insiram informações confidenciais, que podem ser armazenadas ou analisadas sem o devido consentimento. Isso pode levar a violações significativas da privacidade se esses dados forem utilizados para fins maliciosos, como roubo de identidade ou fraudes financeiras. Esses exemplos evidenciam a necessidade de regulamentações robustas e práticas rigorosas para proteger a privacidade dos dados.

O papel da fiscalização humana em sistemas de Inteligência Artificial

A fiscalização humana em sistemas de IA é essencial para garantir decisões justas e éticas, especialmente em áreas críticas como diagnósticos médicos e concessão de crédito. Com isso, a supervisão humana é necessária para interpretar contextos complexos que os algoritmos podem não captar, corrigir vieses presentes nos dados e assegurar a responsabilidade em caso de erros.

É fundamental a implementação de melhores práticas, como auditorias regulares dos algoritmos, garantir a transparência dos processos decisórios e dar a possibilidade de feedback contínuo dos usuários. Além disso, o papel humano deve evoluir para uma colaboração eficaz com a IA, focando em habilidades interpessoais e éticas, enquanto regulamentações claras orientam o uso responsável da tecnologia.

O Panorama do uso da Inteligência Artificial no Brasil

O nosso país enfrenta desafios relacionados à regulamentação, infraestrutura tecnológica e conscientização ética. Iniciativas promissoras demonstram o potencial positivo da IA no Brasil, por exemplo, a tecnologia tem sido utilizada eficazmente no combate a fraudes financeiras e na previsão de demandas no sistema de saúde pública. Esses casos ilustram como a IA pode contribuir para a eficiência e a melhoria dos serviços, beneficiando tanto as instituições quanto os cidadãos.

Apesar dos avanços, o Brasil também enfrenta questões significativas. A desigualdade de acesso à tecnologia é uma preocupação central, pois pode exacerbar disparidades sociais existentes. Além disso, o uso de sistemas de reconhecimento facial em ambientes públicos levanta sérias preocupações éticas sobre privacidade e vigilância, gerando debates sobre os limites do uso dessa tecnologia.

No campo da regulamentação, o Brasil tem feito progressos com propostas como a Lei de Governança Algorítmica e o Marco Legal da IA. Essas iniciativas buscam estabelecer diretrizes para um uso seguro e ético da tecnologia. No entanto, ainda existe uma lacuna significativa entre a criação de políticas e sua implementação prática e fiscalização efetiva.

Além disso, muitas organizações brasileiras ainda não adotaram práticas robustas para o desenvolvimento ético da IA. Essa falta de adoção muitas vezes se deve à escassez de recursos ou ao desconhecimento técnico sobre como implementar tais práticas. Portanto, é fundamental promover debates contínuos que alinhem o uso da IA no Brasil aos padrões internacionais de ética e responsabilidade.

Conclusão

Apesar de a tecnologia ter mostrado seu valor em diversos setores é fundamental que sua implementação seja feita de forma responsável para evitar problemas éticos e de privacidade. É visível a necessidade de uma regulamentação forte, como a Lei de Governança Algorítmica e o Marco Legal da IA, mas a eficácia dessas leis depende de uma fiscalização adequada e da conscientização sobre as questões éticas envolvidas no uso da IA.

Além disso, a desigualdade no acesso à tecnologia e os perigos relacionados ao reconhecimento facial e à coleta de dados pessoais exigem uma abordagem cuidadosa que priorize a justiça e a transparência.

Para que a IA traga benefícios para toda a sociedade, é crucial manter um diálogo constante entre desenvolvedores, reguladores e cidadãos, alinhando as práticas locais aos padrões éticos globais. Somente assim conseguiremos integrar a IA de forma ética e responsável, aproveitando seus benefícios enquanto minimizamos os riscos.

Gerentes perdidos nos dados do SAP? Veja como o BI traz clareza

Integração BI com SAP: Melhora na tomada de decisão

Qual é a importância do gerenciamento de backup para a segurança dos dados?

Qual é a importância do gerenciamento de backup para

Como o Microsoft Power Automate pode simplificar suas tarefas diárias?

Como o Microsoft Power Automate pode simplificar suas tarefas